Stephen Hawking fortsetter "korstoget" mot kunstig intelligens (AI).

Under den svært etterlengtede spør meg om Reddit-kampanjen skrev han at arbeidet med å utvikle en AI-sikkerhetsprotokoll burde gjøres nå, ikke i fjern fremtid.

"Målet vårt skal ikke være å skape abstrakt kunstig intelligens, men å skape nyttig intelligens," skrev den berømte fysikeren, "det vil ta flere tiår å finne ut hvordan vi gjør dette, så la oss begynne å forske på dette problemet nå, og ikke kvelden før lanseringen av den første avansert AI”.

Hawking har brukt berømmelse for å støtte sikkerhetsbevegelsen i AI siden 2014, da han sammen skrev en redaksjon med andre forskere som advarte om den eksistensielle trusselen som avanserte maskiner utgjør for menneskeheten.

Andre bemerkelsesverdige teknologiske personligheter, Elon Musk og Steve Wozniak, har blitt med Hawking. Tidligere i dette signerte alle tre et åpent brev der de ba om forbud mot autonome våpen eller kamproboter.

Forventninger om at menneskeheten snart vil skape kunstig intelligens har eksistert siden 50-tallet og har ennå ikke rettferdiggjort seg. Imidlertid tror de fleste AI-forskere at maskiner som er like intelligente som mennesker vil vises i dette århundret.

Foto: ANDREW COWIE / AFP

Salgsfremmende video:

Hawking advarer om at skildring av kunstig intelligens i science fiction-filmer forvrenger den virkelige faren for maskiner. Filmer som The Terminator skildrer demoniske killeroboter som søker å ødelegge menneskeheten av grunner som ekte kunstig intelligens ikke hadde. De gjør det også lettere å dempe potensiell AI-risiko (som å ikke bygge cyborgs).

“Den virkelige trusselen fra AI er ikke at den er ond, men at den er veldig dyktig. Kunstig superintelligens er veldig flink til å utføre oppgavene sine.

Hvis oppgavene hans ikke samsvarer med vårt, vil vi få problemer, - skrev Hawking, - du hater knapt maur, men hvis du har ansvaret for et grønt energiprosjekt, og området der maurhylen ligger trenger å bli oversvømmet, er maurene flaks. La oss ikke la menneskeheten finne seg i maurenes stilling."

Nick Bostrom, en AI-filosof, fantaserer om verdensscenarier når et program begynner å jobbe i feil retning. For eksempel får kunstig intelligens oppgaven med å utvikle en plan for å beskytte miljøet, og for å løse økologiproblemet bestemmer den seg for å ødelegge menneskeheten.

Elon Musk har allerede forpliktet 10 millioner dollar til AI sikkerhetsforskning for å forhindre destruktiv kunstig intelligens som Skynet fra å vises i Terminator. Men Hawking vil at folk skal endre sin generelle oppfatning av AI.

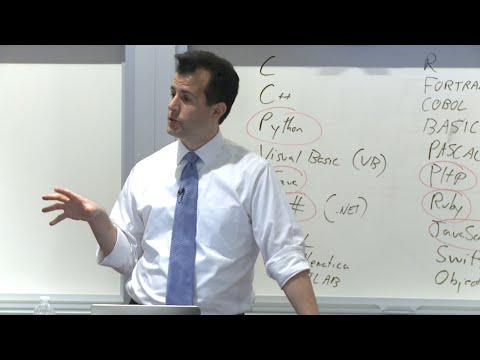

"Fortell studentene dine om ikke bare å tenke på hvordan de lager AI, men også hvordan de kan sikre at den brukes til nyttige formål," sa Hawking til en instruktør som foreleser om kunstig intelligens. "Fremveksten av en AI som overskrider mennesker vil bli enten den beste eller den verste hendelsen i menneskets historie. Derfor er det viktig at alt går som det skal."